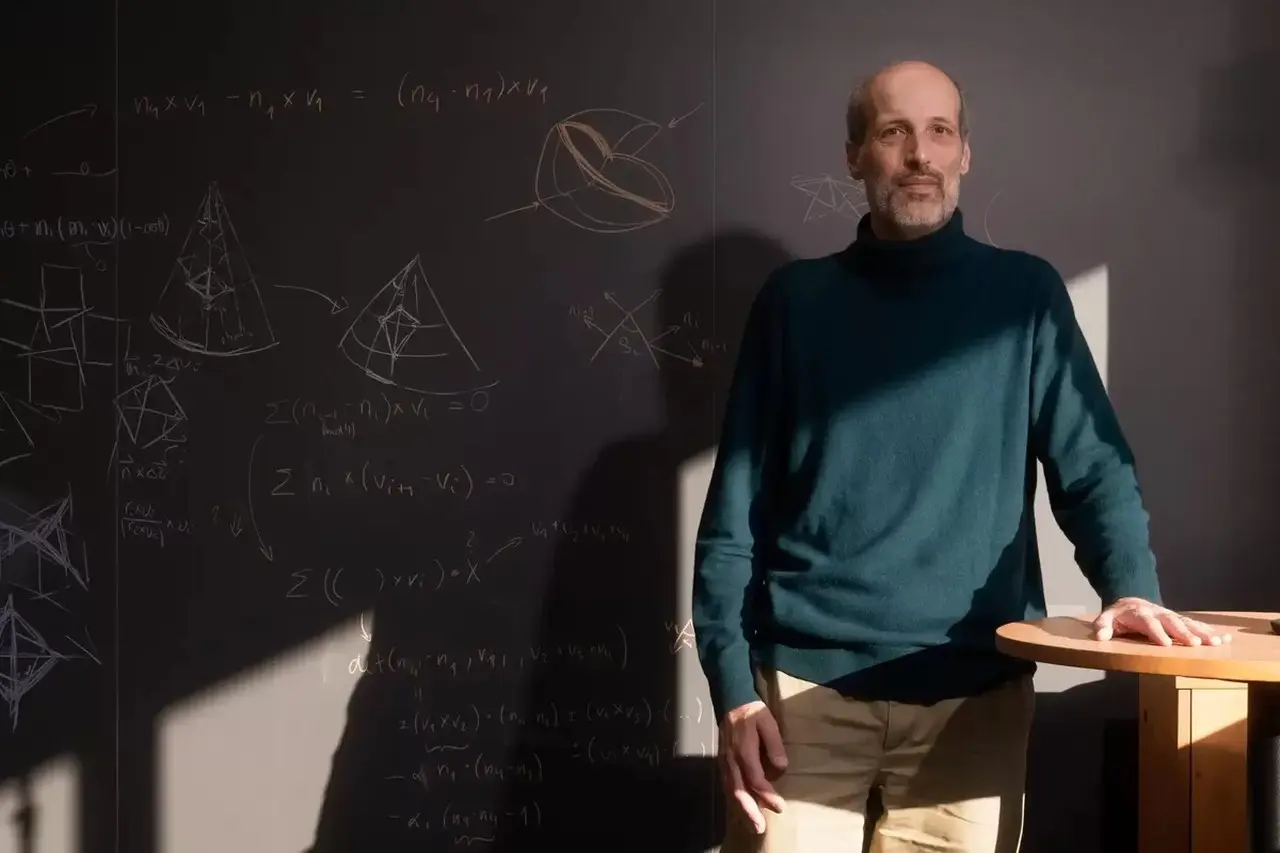

Martin Hairer, peraih Fields Medal 2014, bersama tim matematikawan elit dari Harvard, Stanford, dan MathSci.ai melakukan pengujian terhadap kemampuan kecerdasan buatan (AI) dalam menyelesaikan persoalan matematika tingkat lanjut. Eksperimen bertajuk “First Proof” ini bertujuan untuk membuktikan apakah AI benar-benar mampu menghasilkan pemikiran orisinal atau sekadar mengolah data yang sudah ada.

Eksperimen ini bermula dari kekhawatiran seorang siswa SMA yang mengirimkan surat elektronik kepada Hairer mengenai masa depan bidang matematika di tengah pesatnya perkembangan AI. Menanggapi hal tersebut, Hairer menegaskan bahwa matematika masih berada dalam posisi yang aman dari ancaman otomasi total oleh mesin.

Kegagalan AI dalam Menghasilkan Ide Orisinal

Dalam pengujian tersebut, tim peneliti menggunakan model AI paling mutakhir, termasuk ChatGPT-5.2 Pro dan Google Gemini 3.0 Deep Think. Mereka memberikan soal-soal riset yang belum pernah dipublikasikan untuk memastikan AI tidak bisa mengambil jawaban dari data latihan di internet.

Hairer mengungkapkan bahwa Large Language Model (LLM) memang mahir menyelesaikan soal latihan standar, namun gagal total saat dihadapkan pada konsep baru. “Saya belum melihat contoh yang masuk akal di mana LLM menghasilkan ide atau konsep baru yang benar-benar orisinal,” ujar Hairer.

Kualitas Jawaban yang Bertele-tele dan Tidak Akurat

Hasil eksperimen menunjukkan bahwa jawaban yang dihasilkan oleh AI sering kali tidak akurat atau sekadar “asal bunyi”. Hairer menyamakan kualitas argumen AI dengan mahasiswa tingkat sarjana yang kurang pintar karena cenderung memberikan detail berlebihan pada bagian mudah, namun sangat minim pada inti argumen yang sulit.

AI sering kali melakukan hand-waving atau memberikan argumen yang kabur di tengah pembuktian dengan harapan pembaca tidak menyadarinya. Hal ini menunjukkan bahwa meskipun AI mengetahui titik awal dan tujuan akhir sebuah persoalan, mesin tersebut tidak memahami proses logis untuk mencapainya.

Fenomena Infinite Loop dan Kelemahan Fundamental

Lauren Williams, profesor matematika dari Harvard, menemukan fenomena unik di mana AI sering terjebak dalam lingkaran setan atau infinite loop. Saat diuji dengan masalah riset sungguhan, AI akan memberikan jawaban, lalu mengoreksi dirinya sendiri secara terus-menerus tanpa pernah sampai pada solusi final yang benar.

Selain itu, terdapat beberapa alasan teknis mengapa AI belum bisa menggantikan peran matematikawan profesional, di antaranya:

- Kelemahan Visual: AI memiliki kemampuan yang buruk dalam penalaran visual sehingga gagal pada soal yang membutuhkan imajinasi ruang.

- Daya Ingat Pendek: Kualitas jawaban AI menurun drastis jika pembuktian membutuhkan penjelasan panjang lebih dari lima halaman.

- Sifat Yes Man: AI cenderung hanya mengikuti sudut pandang penggunanya dan tidak bisa diajak berdebat untuk menguji sebuah ide.

Dampak Terhadap Kemajuan Sains

Tamara Kolda dari MathSci.ai memperingatkan bahwa ketergantungan pada AI justru berpotensi memperlambat kemajuan sains di masa depan. Menurutnya, kemajuan ilmiah membutuhkan perdebatan ide dan perspektif baru yang menantang, hal yang tidak bisa dilakukan oleh AI yang hanya mengulang instruksi.

Informasi lengkap mengenai hasil eksperimen dan riset ini dihimpun dari laporan The New York Times dan pernyataan resmi tim peneliti yang dirilis pada Februari 2026.